Si tratta di video falsi, creati grazie alla tecnologia deep learning che permette di sostituire i volti di due persone (face swapping) riproducendone la voce e sincronizzando il labiale. I deepfake, sebbene in alcuni casi possano divertire, sono spesso fonte di fake news. Per far fronte a questo problema è arrivato il contributo di Google che ha dato il via alla creazione di un database di video “fake” per aiutare a individuarne e identificarne sempre di più. E chissà se sarebbe riuscita a riconoscere il falso fuori onda di Matteo Renzi, prodotto e divulgato dalla trasmissione Striscia la Notizia.

Questa sera a #Striscia un fuorionda esclusivo!

È lui o non è lui? Certo che non è lui >> https://t.co/EHD0R8lVeG pic.twitter.com/oR0AwYNlSi— Striscia la notizia (@Striscia) September 23, 2019

Google ha annunciato il lancio di un grande database di deepfake creati appositamente, in collaborazione con Jigsaw, per aiutare a perfezionare il lavoro di identificazione di questo tipo di contenuti. Il database di Google contro i deepfake servirà dunque per allenare gli strumenti di riconoscimento di questi video: in parole semplici, per combattere i deepfake servono altri deepfake. Si tratta di 3mila video creati a partire da immagini di diversi attori e registrati in differenti contesti e scenari: in alcuni i cambiamenti sono davvero minimi, in altri invece sono più evidenti, ma in molti casi risulta davvero difficile distinguere quello reale dal falso. Ha contribuito a questo lavoro anche l’Università Federico II di Napoli.

LEGGI ANCHE: Fake news e social network: che fine ha fatto il pensiero critico?

l deepfake hanno iniziato a diffondersi nel 2017 portando il mondo delle fake news a un livello superiore. Questa tipologia di video modificati è stata sperimentata nel mondo del cinema, dove ha mietuto vittime tra le attrici di Hollywood il cui viso è stato sovrapposto a quello di pornostar protagoniste di video hard. Gal Gadot, l’attrice diventata famosa grazie a Wonder Woman, suo malgrado divenne la diva prescelta per la prima invasione dei deepfake di Reddit. Non è stata l’unica vittima: Jessica Alba, Taylor Swift, Daisy Ridley e molte altre iniziarono a ritrovarsi a loro insaputa protagoniste di film porno. È bastato sovrapporre il viso di un’attrice con quello di un’altra per creare un nuovo filmato.

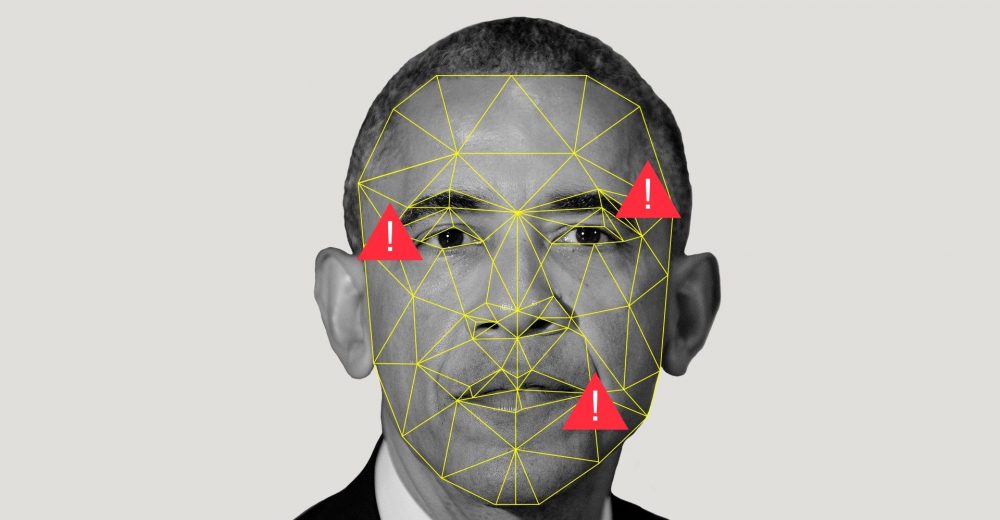

E il passo dal cinema alla politica è stato breve. Ed è proprio l’ex presidente degli Stati Uniti, Barack Obama, a diventare protagonista del più celebre deepfake. Un video in cui un finto Obama, indistinguibile da quello vero, afferma: «Potrei dire cose come ‘Killmonger aveva ragione’. Oppure che il presidente Trump è un completo stronzo». E, ancora, un altro esempio di video manipolato è stato pubblicato dal portavoce della Casa Bianca in occasione dello scontro avuto tra Donald Trump e Jim Acosta, nel corso di una conferenza stampa, con il chiaro scopo di dimostrare che il giornalista aveva respinto brutalmente la donna che era stata incaricata di togliergli il microfono. Anche se il video sembra assolutamente reale e veritiero, grazie all’analisi realizzata da Storyful, un’organizzazione che si occupa proprio della verifica delle notizie, è stato scoperto che al filmato sono stati aggiunti alcuni frame con lo scopo di farlo apparire violento.

We stand by our decision to revoke this individual’s hard pass. We will not tolerate the inappropriate behavior clearly documented in this video. pic.twitter.com/T8X1Ng912y

— Kayleigh McEnany 45 Archived (@PressSec45) November 8, 2018

La tecnologia che sta dietro ai video deepfake negli ultimi tempi è diventata sempre più sofisticata, e distinguere un video vero da uno falso può risultare complicato, con preoccupanti implicazioni per la circolazione della corretta informazione. Il timore è che la tecnologia in questione possa essere utilizzata per manipolare l’opinione pubblica, diffondere notizie false o danneggiare la reputazione di soggetti specifici come per esempio politici e capi di Stato. Che il fenomeno dei deepfake sia un esempio allarmante di quanto le masse possano essere influenzate sempre più facilmente, è un dato di fatto. E che sia necessaria una regolamentazione legislativa chiara e precisa per riuscire a limitare la diffusione di questa tecnologia nella moderna arte delle fake news è ancora più certo. Il punto è, però, che l’unico organo governativo ad interessarsi realmente dell’argomento è il Congresso americano, che sta da tempo puntando a ridurre il rischio potenziale di questa tecnologia, obbligando i vari social network ad utilizzare software in grado di riconoscerli e tutti i creatori di video deepfake ad aggiungere un bollino segnalatore, in modo da rendere chiaramente cosciente lo spettatore che quella riprodotta nel filmato non è la realtà.